De laatste vijftig jaar zijn er enorm veel ontwikkelingen geweest op computergebied. Ik ga je aan de hand van een serie artikelen meenemen door die periode vol ontwikkelingen, vreemde uitvindingen, verdwenen merken en nog veel meer. Vandaag in deel 47 de geschiedenis van de kunstmatige intelligentie: van mechanische droom tot digitale revolutie.

Wanneer we tegenwoordig over kunstmatige intelligentie spreken, denken de meeste mensen aan chatbots, zelfrijdende auto’s, beeldherkenning of computers die menselijke gesprekken voeren. Het lijkt daarmee een typisch verschijnsel van de 21e eeuw. Toch is dat een misvatting. Het idee dat mensen een kunstmatig denkend wezen zouden kunnen maken, is veel ouder dan de computer. De geschiedenis van kunstmatige intelligentie begint niet in Silicon Valley, maar in de menselijke verbeelding.

Oudheid

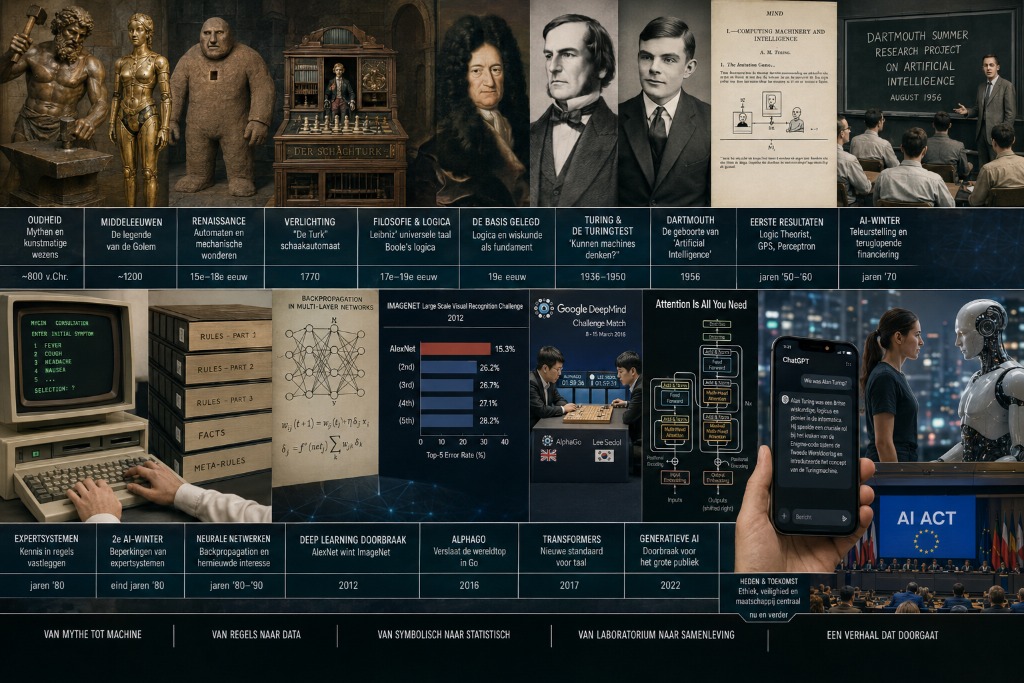

Al in de oudheid bestonden verhalen over kunstmatige wezens. In de Griekse mythologie smeedde de god Hephaistos mechanische dienaren van goud, terwijl in andere verhalen beelden tot leven kwamen. Zulke mythen waren natuurlijk geen techniek, maar ze lieten zien dat het idee van kunstmatig leven mensen al eeuwen bezighield. In de Middeleeuwen verscheen de legende van de Golem, een door mensen gecreëerd wezen dat bevelen kon uitvoeren. Ook dat was in wezen een vroege gedachteoefening over kunstmatig gemaakte intelligentie.

Later

In de renaissance en de eeuwen daarna kreeg die verbeelding een mechanische vorm. Uitvinders bouwden automaten: ingewikkelde machines die konden schrijven, muziek maken of ogenschijnlijk zelfstandig bewegen. Sommige van deze apparaten waren vooral curiositeiten, andere toonden een groeiend geloof dat menselijke vermogens technisch nagebootst konden worden. Een beroemd voorbeeld was “De Turk”, een achttiende-eeuwse schaakmachine die publiek en vorstenhuizen versteld deed staan. Pas later bleek dat er een menselijke schaker in verborgen zat. Toch was de fascinatie veelzeggend: mensen wilden geloven dat een machine kon denken.

Filosoof

De echte basis voor kunstmatige intelligentie ontstond pas toen filosofie en wiskunde elkaar begonnen te raken. In de zeventiende eeuw droomde de Duitse filosoof Leibniz al van een universele rekentaal waarin redeneringen mechanisch uitgevoerd konden worden. Dat idee bleef eeuwen abstract, totdat in de negentiende eeuw George Boole logica in wiskundige vorm goot. Daarmee ontstond iets revolutionairs: redeneren kon misschien worden behandeld als een systeem van regels. Dat inzicht zou uiteindelijk de fundering van digitale computers worden.

20e eeuw

De beslissende sprong kwam in de twintigste eeuw. In 1936 beschreef Alan Turing zijn theoretische universele machine, een concept dat aantoonde dat één algemene machine elke berekening kon uitvoeren, zolang die maar als regels geformuleerd kon worden. Daarmee ontstond in theorie de moderne computer. Maar Turing ging verder. In 1950 stelde hij de beroemde vraag: “Kunnen machines denken?” In plaats van zich te verliezen in filosofische definities, stelde hij een praktische proef voor. Als een mens in gesprek niet kan onderscheiden of hij met een machine of met een ander mens communiceert, is dat dan geen vorm van intelligent gedrag? De zogeheten Turingtest was geboren.

De eerste keer

Die gedachte leidde in 1956 tot wat vaak als de officiële geboorte van kunstmatige intelligentie wordt gezien. Tijdens een zomerse conferentie op Dartmouth College gebruikten onderzoekers voor het eerst de term “Artificial Intelligence”. De verwachtingen waren enorm. Men geloofde serieus dat menselijke intelligentie binnen enkele decennia volledig in machines nagebouwd kon worden. Achteraf oogt dat naïef, maar het optimisme was begrijpelijk. Computers hadden net laten zien dat ze konden rekenen op een schaal die voor mensen onmogelijk was. Waarom zouden ze dan niet ook leren, redeneren of problemen oplossen?

De eerste resultaten leken dat vertrouwen te bevestigen. Programma’s als Logic Theorist konden wiskundige stellingen bewijzen, terwijl de General Problem Solver algemene problemen probeerde op te lossen. In dezelfde periode verscheen het perceptron, een vroege vorm van neuraal netwerk dat patronen kon herkennen. Het was primitief vergeleken met moderne systemen, maar het introduceerde een idee dat uiteindelijk enorm belangrijk zou blijken: een machine kon leren uit voorbeelden in plaats van alleen vaste instructies te volgen.

Toch botste dit optimisme op de werkelijkheid. De wereld bleek veel rommeliger dan onderzoekers hadden verwacht. Problemen die eenvoudig leken, zoals visuele herkenning of taalbegrip, bleken uitzonderlijk moeilijk. Computers waren bovendien traag en geheugencapaciteit was beperkt. In de jaren zeventig leidde dit tot teleurstelling en fors teruglopende financiering. De eerste “AI-winter” begon.

Jaren ’80

Maar kunstmatige intelligentie verdween niet. In de jaren tachtig keerde het terug in een nieuwe vorm: expertsystemen. Deze programma’s probeerden specialistische menselijke kennis in regels vast te leggen. In plaats van algemene intelligentie na te streven, richtten ze zich op concrete taken zoals medische diagnoses of industriële configuraties. Sommige systemen werkten verrassend goed en leverden grote economische waarde op. Even leek AI toch door te breken.

Opnieuw bleek de werkelijkheid weerbarstig. Expertsystemen vereisten enorme hoeveelheden handmatig ingevoerde kennis en waren moeilijk te onderhouden. Zodra de complexiteit groeide, liep het systeem vast. Tegen het einde van de jaren tachtig volgde een tweede AI-winter.

Achter de schermen vond ondertussen echter een verschuiving plaats die uiteindelijk veel belangrijker zou blijken dan expertsystemen. Onderzoekers begonnen minder nadruk te leggen op regels en meer op statistiek en data. Niet langer moest men intelligentie volledig programmeren; machines konden patronen leren uit grote hoeveelheden voorbeelden.

Dat idee kreeg nieuwe kracht met de heropleving van neurale netwerken. In de jaren tachtig werd backpropagation, een methode om meerlaagse netwerken te trainen, praktisch bruikbaar. Lange tijd bleef dat vooral academisch interessant. Computers waren simpelweg nog niet krachtig genoeg om grote netwerken effectief te trainen.

Deze eeuw

Dat veranderde in de 21e eeuw. Snellere processors, grafische kaarten en explosief groeiende datasets brachten oude ideeën ineens tot leven. In 2012 kwam de grote doorbraak. Een neuraal netwerk genaamd AlexNet won een beeldherkenningswedstrijd met een ongekende voorsprong. Voor velen was dat het moment waarop duidelijk werd dat deep learning geen niche meer was, maar een fundamentele revolutie.

Plotseling volgden de successen elkaar snel op. Computers herkenden gezichten, vertaalden talen en versloegen mensen in steeds complexere spellen. Toen DeepMind’s AlphaGo in 2016 de wereldtop in Go versloeg, gold dat als historisch. Go was lang beschouwd als een spel dat te intuïtief was voor machines. Toch gebeurde het.

Een nog grotere doorbraak volgde in 2017 met de publicatie van het transformer-model. Deze techniek bleek uitzonderlijk geschikt om taal te verwerken en vormde de basis voor moderne grote taalmodellen. Zonder transformers geen ChatGPT, geen generatieve AI, geen huidige explosie van toepassingen.

2022

Met de publieke doorbraak van generatieve AI vanaf 2022 veranderde ook de maatschappelijke betekenis van kunstmatige intelligentie. Waar AI vroeger vooral iets was voor laboratoria, universiteiten of gespecialiseerde bedrijven, werd het ineens zichtbaar voor iedereen. Miljoenen mensen konden direct ervaren dat machines teksten konden schrijven, vragen beantwoorden en creatieve taken uitvoeren.

Geen rechte lijn

Toch is het belangrijk om te beseffen dat deze geschiedenis geen rechte lijn van onafgebroken vooruitgang is geweest. Kunstmatige intelligentie is gevormd door golven van overschatting en teleurstelling. Bijna iedere generatie onderzoekers dacht op enig moment dat algemene machine-intelligentie binnen handbereik lag. Bijna iedere generatie bleek te optimistisch.

Juist daarin schuilt een belangrijke historische les. Veel ideeën die vandaag revolutionair lijken, bestaan in concept al tientallen jaren. Vaak ontbrak niet de theorie, maar de rekenkracht. De geschiedenis van AI is daarom evenzeer een geschiedenis van chips, hardware en schaalvergroting als van algoritmen.

Een tweede les is dat kunstmatige intelligentie nooit één uniforme stroming is geweest. Symbolische systemen, statistische methoden en neurale netwerken hebben elkaar niet simpelweg vervangen, maar elkaar voortdurend beïnvloed. Veel moderne systemen combineren nog altijd elementen uit meerdere tradities.

Vandaag verschuift het debat opnieuw. Waar vroeger de vraag centraal stond óf machines intelligent konden worden, gaat het nu steeds vaker over wat die intelligentie mag doen. Vraagstukken rond bias, desinformatie, autonomie, veiligheid en regulering staan centraal. Met Europese wetgeving, mondiale concurrentie en discussies over kunstmatige algemene intelligentie is AI niet alleen een technisch, maar ook een politiek en maatschappelijk onderwerp geworden.

Of machines ooit menselijke algemene intelligentie bereiken, weet niemand. Misschien blijkt het haalbaar, misschien blijkt bewustzijn fundamenteel anders dan berekening. De geschiedenis van AI leert in elk geval dat voorspellingen op dit terrein zelden betrouwbaar zijn.

Misschien is dat ook de belangrijkste conclusie. De geschiedenis van kunstmatige intelligentie is uiteindelijk niet alleen een verhaal over machines. Het is vooral een verhaal over menselijke pogingen om intelligentie zelf te begrijpen. Iedere stap vooruit in AI onthult niet alleen iets over computers, maar ook over onszelf. En juist daarom is deze geschiedenis nog lang niet voltooid.

Redactionele noot

Zoals bij veel technologische geschiedenis geldt ook hier dat interpretaties kunnen verschillen. Sommige historici leggen het begin van AI bij Turing, anderen bij Dartmouth, en sommigen zelfs bij eerdere logische en mechanische tradities. In dit artikel is bewust gekozen voor een brede historische benadering.

De bij dit artikel gebruikte afbeelding is digitaal gegenereerd met behulp van kunstmatige intelligentie en vertegenwoordigt geen daadwerkelijk gefotografeerde situatie.

Heeft dit artikel jouw interesse gewekt? Sluit je dan aan bij HCC!ai, de Interessegroep die zich bezighoudt met artificiële intelligentie.

Meer artikelen in de serie De geschiedenis van vind je hier

Over de auteur

Over de auteur

Marco Mekenkamp is eindredacteur van PC-Active. Dit 108 pagina's tellende magazine verschijnt elke twee maanden en is te koop in de winkel. Leden van HCC krijgen PC-Active zes keer per jaar thuisgestuurd als onderdeel van het HCC-lidmaatschap.